人工智能(AI)技術近年來在軍事領域的應用日益廣泛,從智能決策支持系統到自主武器系統,AI為現代戰爭帶來了革命性的變化。這些應用也伴隨著諸多技術、倫理和安全挑戰。本文將探討AI在軍事應用中的可能性,以及AI軟件開發過程中面臨的主要問題。

一、人工智能軍事應用的可能性

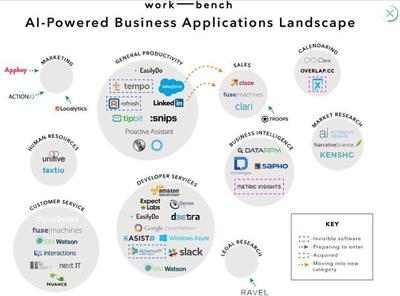

- 智能決策與指揮:AI可以通過大數據分析和機器學習模型,輔助軍事指揮官進行快速、準確的決策。例如,AI系統能夠模擬戰場環境,預測敵方行動,優化作戰計劃,提高作戰效率。

- 自主武器系統:AI驅動的無人系統(如無人機、無人戰車)具備自主導航、目標識別和攻擊能力,能夠在高風險環境中執行任務,減少人員傷亡。這些系統能夠24小時不間斷運作,提升軍事行動的持續性和精確性。

- 情報分析與網絡安全:AI技術能夠處理海量情報數據,自動識別威脅模式,提高情報收集和分析的效率。AI在網絡安全領域的應用可以實時監測和防御網絡攻擊,保護軍事信息系統免受入侵。

- 后勤與訓練優化:AI可以優化軍事后勤管理,通過預測需求、調度資源,降低運營成本。在訓練方面,虛擬現實(VR)和AI結合可以創建逼真的模擬環境,提升士兵的訓練效果。

二、人工智能軍事應用軟件開發面臨的挑戰

- 技術挑戰:

- 數據質量與可靠性:AI系統依賴大量高質量數據,但軍事數據往往涉及機密,且可能存在不完整或偏差問題,影響AI模型的準確性。

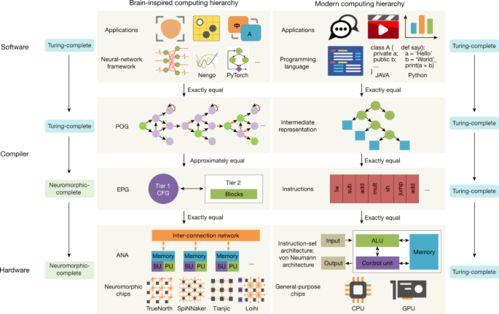

- 算法魯棒性:在復雜多變的戰場環境中,AI算法需要具備高度的魯棒性,以應對意外情況和干擾。當前AI系統在面對未知場景時容易出錯。

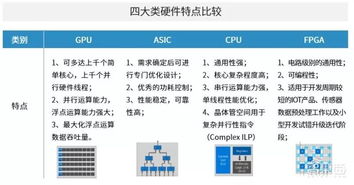

- 集成與兼容性:將AI系統集成到現有軍事裝備和指揮體系中存在技術障礙,需要解決軟硬件兼容性問題。

- 倫理與法律挑戰:

- 自主武器系統的道德爭議:自主武器是否應具備“殺人”決策權引發了廣泛倫理爭議。國際社會對AI武器的監管尚不完善,可能導致濫用風險。

- 責任歸屬問題:當AI系統出現失誤時,責任應由開發者、操作者還是AI本身承擔?這需要明確的法律框架。

- 安全與風險挑戰:

- 系統脆弱性:AI系統可能受到 adversarial attacks(對抗性攻擊),導致誤判或失效。在軍事應用中,這種脆弱性可能帶來災難性后果。

- 數據隱私與泄露:軍事AI系統處理敏感數據,若安全措施不足,可能導致機密信息泄露。

- 開發與維護挑戰:

- 高成本與資源需求:AI軍事應用的軟件開發需要大量資金、專業人才和計算資源,且維護成本高昂。

- 測試與驗證困難:由于軍事環境的特殊性,AI系統難以在實際場景中進行全面測試,增加了部署風險。

結語

人工智能在軍事領域的應用潛力巨大,能夠顯著提升作戰效率和軍事能力。其軟件開發和應用過程中面臨的技術、倫理、安全等多重挑戰不容忽視。需要在技術創新、法律法規和國際合作方面共同努力,以確保AI軍事應用的負責任發展。通過加強AI系統的透明度、可靠性和安全性,我們可以最大限度地發揮其優勢,同時規避潛在風險。