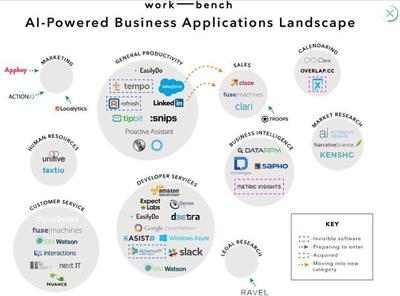

人工智能技術(shù)以前所未有的速度發(fā)展,已深度融入醫(yī)療、金融、交通、教育等關(guān)鍵領(lǐng)域。隨著AI應(yīng)用軟件開(kāi)發(fā)的快速推進(jìn),安全問(wèn)題日益凸顯,成為制約人工智能健康發(fā)展的關(guān)鍵因素。

在AI應(yīng)用開(kāi)發(fā)過(guò)程中,數(shù)據(jù)安全始終是首要考量。訓(xùn)練數(shù)據(jù)的質(zhì)量與安全性直接影響模型性能,若數(shù)據(jù)存在偏見(jiàn)或遭受污染,將導(dǎo)致決策偏差,在醫(yī)療診斷、信貸審批等場(chǎng)景可能造成嚴(yán)重后果。開(kāi)發(fā)者必須建立嚴(yán)格的數(shù)據(jù)治理體系,確保數(shù)據(jù)采集、標(biāo)注、存儲(chǔ)全流程安全可控。

算法安全同樣不容忽視。對(duì)抗性攻擊可能通過(guò)微小擾動(dòng)欺騙AI系統(tǒng),自動(dòng)駕駛中的交通標(biāo)志識(shí)別、人臉認(rèn)證系統(tǒng)都曾因此暴露出安全隱患。開(kāi)發(fā)團(tuán)隊(duì)需要將安全測(cè)試貫穿整個(gè)開(kāi)發(fā)生命周期,采用對(duì)抗訓(xùn)練、形式化驗(yàn)證等方法提升模型魯棒性。

隱私保護(hù)是AI應(yīng)用必須跨越的另一道門檻。聯(lián)邦學(xué)習(xí)、差分隱私等技術(shù)創(chuàng)新讓用戶數(shù)據(jù)"可用不可見(jiàn)"正在成為行業(yè)標(biāo)準(zhǔn)。開(kāi)發(fā)者在設(shè)計(jì)架構(gòu)時(shí),就應(yīng)將隱私保護(hù)作為核心要素,而非事后補(bǔ)救。

AI系統(tǒng)的透明度和可解釋性也關(guān)系到應(yīng)用安全。在關(guān)鍵決策場(chǎng)景,黑箱模型可能帶來(lái)不可預(yù)知的風(fēng)險(xiǎn)。通過(guò)開(kāi)發(fā)可解釋AI技術(shù),建立算法審計(jì)機(jī)制,才能增強(qiáng)用戶信任,促進(jìn)負(fù)責(zé)任的人工智能發(fā)展。

人工智能的安全發(fā)展需要多方協(xié)同:技術(shù)團(tuán)隊(duì)需將安全理念融入開(kāi)發(fā)基因,行業(yè)組織應(yīng)加快安全標(biāo)準(zhǔn)制定,監(jiān)管機(jī)構(gòu)要完善法律法規(guī)。只有在安全基石上構(gòu)建的人工智能應(yīng)用,才能真正賦能各行各業(yè),推動(dòng)社會(huì)進(jìn)步。